Google、AIライブラリ「T2T」にMultiModelを追加 画像、言語、音声などの異なるタスクを同一ネットワークで処理

21日、米Googleはニューラルネットワークアーキテクチャ「MultiModel」を人工知能ライブラリ「Tensor2Tensor」の一部としてオープンソース化することを公式ブログで発表した。

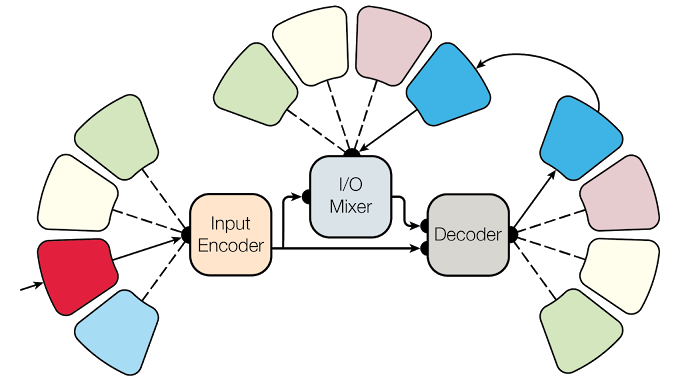

今までのディープラーニングは画像、翻訳、音声などそれぞれのデータを個別に学習することが中心で、それらを複合的に学習することは少なかった。そこで、MultiModelは画像、音声、言語を同じネットワークで処理するアーキテクチャとして作られた。

この様々な種類のデータを同じネットワークで学習する手法は、脳が音、視覚、味などの五感の入力を単一の表現に変換し、言語や動作として出力する方法が元になっている。

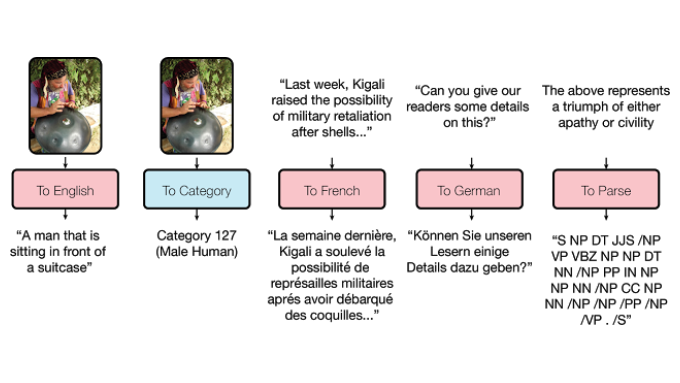

Googleによる実験では、MultiModelは画像内の物体の検出、キャプションの提供、スピーチの認識、4つの言語間での翻訳、文法構成解析などの異なるタスクを同時に8つ学習できることが実証された。また、ある実験では画像認識タスクが言語タスクの性能を改善したという結果が出ており、MultiModelの学習ではとあるタスクが関係のないように見える他のタスクの処理を改善することが明らかになった。

MultiModelはTensor2Tensorライブラリの一部であり、Tensor2TensorはGitHubからダウンロードできる。

(TEXT by ぱソんこ)

●関連記事

・Google、人工知能ライブラリ”TensorFlow”の画像認識API公開 単一画像から複数の物体を検出

・Google、TensorFlow訓練用ライブラリ「Tensor2Tensor」公開 モジュール化で比較や再計算が容易に

●関連リンク

・MultiModel: Multi-Task Machine Learning Across Domains(Google Research Blog)

・Tensor2Tensor(GitHub)