Hololens、Tango…… 次世代「AR 2.0」の仕組みは今までと何が違う?【GDC2016】

米国サンフランシスコにて開催中のゲーム開発者向けイベント「GDC 2016」では、現地時間3月14、15日、今年初めての試みとしてVR専門のセッションを集めた「VRDC」(Virtual Reality Developer Conference)が実施された。

本稿では、3月14日に講演があった「Augmented Reality 2.0: Developing Experiences for Google Tango and Beyond」について解説する。登壇者は、AR/VR系のアプリ開発からコンサルタントまで広く手がけるFLARBのCEO、Ralph Barbagallo氏だ。

Jessy Schell氏の講演と同様、セッションルームが満員になるほどの盛況ぶりで、入れなかった参加者は、近くの廊下に設置されたモニターで講演の中継を見ることになった。

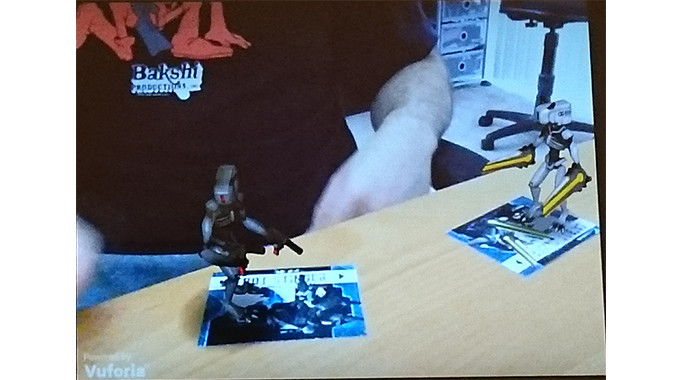

まず、冒頭ではゲームにおけるARの利用例を紹介し、それらは基本的に画像認識がベースであることを説明。

カメラをカードにかざすと、キャラクターが出てきて対戦を始めるゲームだ。カードの柄から特徴を抽出し、特徴点として保持することで、カード上にCGを表示させられる。

この方法であれば、カードを動かしてもCGのキャラクタが追随するし、色々と自由度も高いが、氏によると以下の問題があるという。

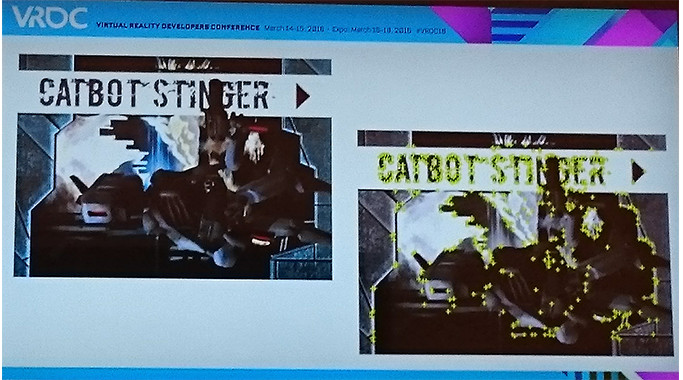

・類似ターゲットが多数あると見分けが付きづらい

・照明など、プレイ中の光環境が、画像認識の精度に影響する

・50から100くらいの同時認識が限界

これらを踏まえて、次世代となるのが「AR 2.0」だ。自己位置推定と空間マッピングを同時に行う「SLAM」(Simultaneous Localization And Mapping)と、周辺の3次元空間情報を3次元カメラで取得する「Depth Mapping」という2点が特徴になる。

SLAM

SLAMとは、ロボットの自立歩行を実現するため、自分の位置と周辺地図を同時につくる技術である。具体的には、自身の移動はGPSで取得し、レーザーを飛ばして戻りまでの時間で周辺の物体を調べて、3次元的な位置と周辺の状況を把握する。

ただし、部屋がきれいすぎたり(=特徴点が少ない)、画像認識のときと同様光の影響を受けるとベストな性能を発揮できない。SLAM自体はロボット関係の分野では古くからあり、氏によると火星に飛ばしたロボットにも入っていたという。

Depth Mapping

Depth Mappingとは、3次元カメラを利用した空間の認識方法だ。3次元カメラは「Kinect」などに使われているもので、被写体に赤外線を照射し、その反射を計測することで物体との距離や形を把握する。通常のカメラは映した風景を二次元的に記録することが一般的だが、3次元カメラなら被写体がカメラから何m離れているかといった奥行きまで取得できる。

一方で、一般的なカラーカメラよりも解像度が低い、フレームレートが低いので、ゆっくり動かさないと深度を検出できない、窓、鏡など、反射率の高いものを検出できないといった制約もあるという。また、トラッキング可能な物体がプレイ空間に満たされている必要があることも指摘していた。

AR 2.0の活用例としてあげられていたのが、MicrosoftのHoloLensだ。視野角(装着したときに見える範囲)はまだ狭いが、性能はGoogleの「Project Tango」よりも上とのこと。AR 2.0の世界実現にはまだまだ色々とやれることがあると触れて、講演は終了した。

HoloLensの開発キットは、価格が3000ドルで、3月30日に米国とカナダに向けて出荷される。GDC開始日にはARアプリ「ActionGram」の活用例をYouTubeで公開していた。宇宙飛行士が出現したり、隣にゾンビが座っていたりする活用例を紹介している。

ARが1.0から2.0に進化してやれることは増えたが、まだ制限事項もある。今後、3.0、4.0と進化していけば、「マイノリティレポート」や「アイアンマン」、「ソードアート・オンライン」といった世界の実現に近づくので、今後にも期待したい。

●関連リンク

・Microsoft Hololens

・Project Tango

・GDC 2016