みなさん、一体型MRゴーグル「VIVE XR Elite」には、追加デバイスとして 「VIVEフルフェイストラッカー(XRシリーズ)」 があることはご存知だろうか。

目線から口元まで、自身の動きに合わせてアバターの表情を自在に操る「フェイシャルトラッキング」(通称:顔トラ)は、特にコミュニケーションに特化したソーシャルVRやメタバースの世界でコアなユーザーから羨ましがられる。しかし、追加デバイスが必要なことに加えて、プラットフォーム側の対応や、使用するアバターの対応有無など、少しハードルが高く感じてしまうのも事実。

そこで、本記事では「VIVE XR Elite」を使って「VRChat」でフェイシャルトラッキングを行う方法を、 必要デバイスから、Unityを用いたアバター側のセットアップまで、丁寧に解説していく。「目は口程に物を言う」ということわざにある通り、目線を含めた「表情」はコミュニケーションの情報量をぐっとあげてくれる。さらに、ふとした瞬きや、頬の膨らみ、舌の動きなどフェイシャルトラッキングによって、アバターの可愛さ、魅力もさらに引き出せるようになる。ぜひ、本記事を参考にあなたも顔トラデビューを果たしてみてほしい。

必要なデバイスとセットアップ

まず、必要なデバイスについて。「VIVE XR Elite」(17万9000円、税込、以下同)と同機専用の追加アクセサリー「VIVEフルフェイストラッカー(XRシリーズ)」(3万1000円)の2つだけ!フルボディトラッキングを行いたい場合は、追加で「VIVEトラッカー(Ultimate)」(3個+ドングル1本セットで9万1900円)を用意しよう。

このXR Elite向けのフェイシャルトラッカーは、従来の「VIVEフェイシャルトラッカー」と異なり、目線用のトラッキングカメラと、口元用のトラッキングとが一体となっている。

まず、XR Eliteのフェイスクッションを取り外し、レンズ間の距離を最大にするために、IPDスライダーを全て右に動そう。あとは、そのままフェイシャルトラッカーをヘッドセットに取り付けるだけだ。取り付ける際に、フェイシャルトラッカーのUSBコネクタがしっかりとヘッドセット側に差し込まれていること、ヘッドセットとフェイシャルトラッカーの間に隙間が空いていないことをチェックしよう。

次に、トラッカー底部のリップカバーを開き、ロックスイッチをロックする。これで、ヘッドセットとの固定は完了だ。最後に、フェイスガスケットを装着し、ハード側の準備は完了となる。

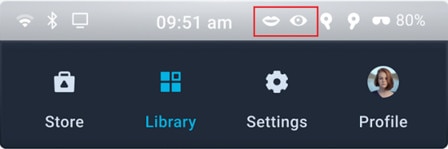

ヘッドセットを装着すると、アイトラッキングのキャリブレーションを行う指示が表示される。この際に、IPDの調整も自動で行われるため、しっかりとヘッドセットを装着し、キャリブレーションを済ませよう。無事に設定が終了したら、システムダッシュボードににアイ/リップトラッキングアイコンが表示されるはずだ。

最後に、VIVEPORTから入手した「VRChat」を起動する。「VRChat」側では特に複雑な設定は必要ない。トラッキングデータの送信にOSCを使用しているため、もしOSCが無効になっていたら、有効に切り替えよう。ちなみに、筆者の体験だが、上手くトラッキングが反映されていない場合は、OSCを一度無効にし、再度有効にすれば治ることがある。

アバター側のセットアップ手順例

と、デバイス側の設定としてはこんなもの。ここからは、アバター側のセットアップについて簡単に紹介していきたい。というのも、このVRChatのフェイシャルトラッキングが一般的になったのは、「OSC」への正式対応が発表された2022年2月以降のこと(関連記事)。まだまだ、標準的にアバター側が対応しているとはいえず、自身が普段利用しているカスタムアバターにてフェイシャルトラッキングを活かすためには、アバター側に専用のパッチを適用する必要がある。

「OSC」というのは、「OpenSound Control」の略称で、本来は電子楽器とコンピュータなどの機器において、音楽演奏データをネットワーク経由でリアルタイム通信するプロトコルを指す。しかし、この仕組みを用いることで、音楽演奏データに限らず、外部ツールとの間でさまざまなデータを送受信することが可能となり、有志開発者を中心に多様なツールが開発されてきた。そのなかのひとつが、「VRCFaceTracking」(公式ドキュメント)などの目線・表情データを送信するツールである。

目線・表情のデータをやり取りできたとして、それをアバターに反映するためには、アバター側の表情パラメータがそれらのデータと対応していなければならない。

「VIVEフルフェイストラッカー(XRシリーズ)」は、先述の「VRCFaceTracking」に対応しているのだが、現状の多くのVRChat向け販売アバターは、そのままの状態では同OSCツールから送信されるパラメータに対応していない。そのため、自らアバターのExpressionパラーメータを追加設定するか、それぞれのアバターに対応した有志開発の追加パッチを購入し、適用するかをしなければならない。いずれにしても、Unityでの操作が必要になる。

そこで、今回は筆者が普段利用しているVRChat向けアバター「『シフォン』-Chiffon-」(販売リンク)を例にとり、セットアップの一例を紹介したい。

今回使用したのは、こちらの「VRCFT v5.0」対応のアドオン商品(販売リンク)。

アバタークリエイターとも異なる有志の開発者がBOOTH上で販売しているものだ。このように、自身の利用したいアバターに対応した有志開発のアドオンを探すのが最も簡単で確実な方法だ。具体的には、「BlendShare」を使用して元のFBXを変更しているとのこと。

①改変支援ツールである「Modular Avatar」と、フェイシャルトラッキングに対応させたいアバターをUnityプロジェクトにインポート

②本ツール「「シフォン」(Chiffon) Face Tracking Addon」よりUnityPackageをインポート

③上方のメニューバーより、「TriturboFT」→「Chiffon_FT」をクリック

④ウィンドウの「アバター」欄にアバターのGameObjectまたはPrefabをドラッグ

⑤最後に、「Apply Face Tracking Addon」をクリックする。

あとは、通常通りの手順でアバターをアップロードするだけ。「VRChat」上で着用すれば、手元のRadial Menuに新たな項目が追加されているはずだ。

このように、現在は「アバターに設定が必要」といっても、有志の開発ツールを用いることによって、ほぼ自動でフェイシャルトラッキング対応アバターを作成することができるようになっている。

「表情」は口ほどにものを語る 顔トラでアバターをもっと可愛く

さて、これでフェイシャルトラッキングを使う準備は万全だ。ところで、VRChatユーザーはなぜ、ここまでして「表情」のトラッキングを行いたいのだろうか。通常の表情操作であれば、コントローラー経由でのジェスチャーにより十分に表現できる。わざわざ、追加デバイスを購入し、そのうえでアバター側のセットアップもそれ専用に行ってまで「表情」を現実と同期させる理由はあるのだろうか?実のところ、筆者も実際にフェイシャルトラッキングユーザーを見るまでは、そして自分自身で体験してみるまでは、少なからずそう思っていた節がある。

しかし、「目は口程に物を言う」ということわざもあるように、やはり「目線」が動き、「口」や「頬」の細かい動きまで反映されるフェイシャルトラッキングは、コミュニケーションにおける情報量・表現力が格段に上がると感じる。なにより、アバターがもっと可愛くなる!

そう。「リアルの表情がアバターに反映される」とはいうが、実際のところVRChatのフェイシャルトラッキングは、かなりデフォルメされるし、強調される。「自分、そんなに表情豊かじゃないからな」と思っても、実際に使ってみると、かなり豊かな表現力を引き出すことができるのだ。そこは表情アニメーションを制作している有志のクリエイターたちに賛辞を送りたい。

ちなみに、この「HTC VIVE XR Elite」でのフェイシャルトラッキングにはもう一つ秘密がある。それは、スタンドアロン版「VRChat」にも対応しているということだ。そう、フェイシャルトラッカーもスタンドアロン版に対応している。単機でも、フェイシャルトラッキングが”技術上は”可能なのだ。

しかし、筆者が調べてみたところ、Quest版モデルに対応しているVRCFaceTrackingをサポートする追加パッチは、見つけることができなかった。執筆時点においては、PC VR版アバターほど簡単に、Quest版アバターをフェイシャルトラッキングに対応させることは難しそうだ。

それでも、目線のトラッキングだけであれば、特別な設定は必要ない。後々、いわゆるQuest対応アバター向けのVRCFT用アドオンが充実してくれば(もしくは、自身でパラメータに対応した表情設定を行えば)、 ハードウェアの性能上はスタンドアロンにて、VRChatのアバター表現がPC VRに劣らずにできる。 もちろん、VIVEシリーズであれば、「VIVEトラッカー(Ultimate)」も用いれば、スタンドアロン版VRChatで全身も顔もすべてトラッキングが可能ということだ。欲を言えば、この点がユーザーの間に周知されて、徐々にスタンドアロンで気軽に表情トラッキングを楽しめる環境が整っていってほしいと願いたい。

(提供:HTC)

*VIVE XR EliteやVIVEトラッカーなどのHTC特集ページはこちら!